AI 비디오의 지각변동: HappyHorse-1.0은 어떻게 Seedance 2.0을 꺾고 왕좌를 차지했나?

Avant

Avant지난 48시간 동안 여러분의 X(트위터) 피드나 AI 커뮤니티가 나와 같은 상태였다면 아마도 'Happy Horse' 콘텐츠의 물결에 휩싸였을 것입니다.

별도의 기조연설이나 화려한 홍보 없이도,HappyHorse가 LMSYS 아레나를 완전히 휩쓸어 ByteDance의 Seedance 2.0을 텍스트-비디오 및 이미지-비디오 모두에서 새로운 1위로 끌어내렸습니다. 하지만 이는 단순히 Elo 점수가 높아지는 것만을 의미하는 것이 아닙니다. 이는 "비공개 소스" 현상 유지에 대한 완전한 혼란입니다.

베일에 싸인 출처부터 기본 멀티모달 아키텍처까지, HappyHorse가 전문 AI 비디오의 새로운 표준이 된 이유는 다음과 같습니다.

이 글에서 배울 내용:

가계도 - "Mystery Model"에서 신원 공개까지

처음 48시간 동안 AI 커뮤니티는 고위험 추측 게임을 진행했습니다. Google Veo의 은밀한 유출이나 새로운 Silicon Valley 거물급 인물에 대한 많은 베팅과 함께 소문이 돌았습니다.

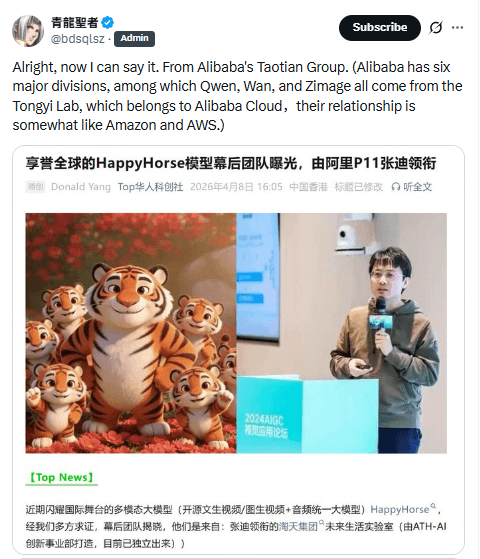

일단 밝혀진 진실은 업계 전체에 충격을 안겨주었습니다. 이 회사는 소규모 스타트업이 아닙니다. 이것은 오늘날 비디오 세대에서 가장 강력한 기록을 보유하고 있는 사람인 Zhang Di가 이끄는 Alibaba의 "미래 생활 연구소"(TTG)의 작업입니다.

모션의 설계자: Zhang Di는 누구인가?

Zhang Di는 일반적인 기술 리더가 아닙니다. 그는 "완전한 순환" 스토리를 지닌 헤비급 베테랑입니다.

학문적 핵심:Shanghai Jiao Tong University 졸업생 (학사 및 석사).

클링 시대:Kuaishou의 전 VP이자 Kling AI의 개발 총괄인 그는 중국이 Sora의 역량에 필적하고 어떤 면에서는 능가할 수 있음을 입증한 첫 번째 모델의 설계자였습니다.

알리바바 홈커밍:Kuaishou에서 근무하기 전에는 Alimama에서 빅 데이터 및 ML 엔지니어링 아키텍처를 이끌었습니다. 이제 Alibaba에서 P11 리더로 돌아와 Zheng Bo(Alimama의 CTO이자 TTG의 수석 과학자)에게 직접 보고합니다.

HappyHorse는 실험이 아닙니다. 이는 업계 엘리트 "전자상거래 + 시각적 AI + 멀티모달" 전문가 집단의 결과입니다. 단지 단순한 전시용 모델이 아니라 생산 작업 흐름을 지배하기 위해 만들어진 모델입니다.

Seedance 2.0 킬러? HappyHorse 블라인드 테스트 비교.

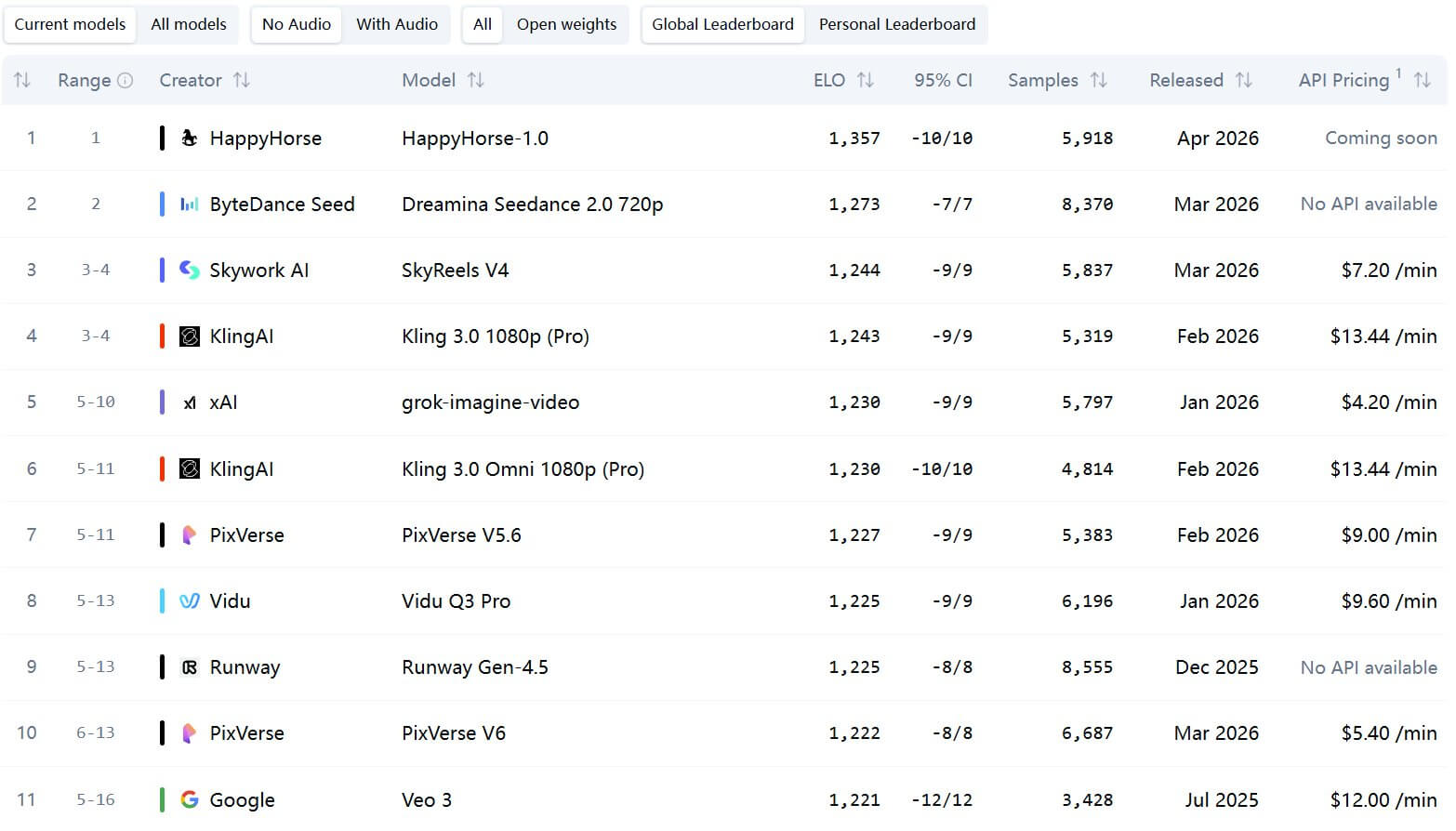

인공 분석 비디오 아레나의 순위는 단순한 마케팅 허세나 엄선된 홍보 영상 그 이상입니다. 이는 커뮤니티의 수천 번의 블라인드 "A/B" 테스트를 통해 강화된 엄격한 Elo 기반 시스템을 기반으로 구축된 원시 사회적 증거입니다.

텍스트-비디오: Elo 1379로 HappyHorse는 2위인 ByteDance의 주력 제품 Seedance 2.0을 무려 106포인트 차이로 제치고 1위를 차지했습니다. 이를 고려하면 Seedance 2.0은 몇 달 동안 이 목록에서 확실한 헤비급 챔피언이었습니다.

이미지-비디오: Elo 1411로 두 번째 카테고리를 휩쓸었으며 필드에서 55점 차이를 기록했습니다.

메모

메모

"Arena" 논리를 이해하는 것이 중요합니다. 사용자는 어떤 모델이 어떤 것인지 알지 못한 채 나란히 놓인 클립에 투표합니다. 높은 Elo는 단순히 "더 나은 물리학"을 의미하는 것이 아니라 인간 중심적인 매력을 의미합니다. 이는 원시 합성 데이터보다 미적 직관을 우선시하여 인간의 눈에 "올바르게" 보이는 것을 측정하는 것입니다.

나는 오후 내내 아레나를 직접 돌아다니며 시간을 보냈습니다. 일대일 전투에서 지속적으로 이 '말(HappyHorse)'에 베팅해본 결과 현실은 부인할 수 없습니다. 이것은 단순한 초기 인기가 아닙니다. HappyHorse-1.0은 합법적인 강국입니다.

드러내다:

첫 번째 대결에서는 밤과 낮의 차이가 컸다. 오른쪽에는 미묘한 조명, 풍부한 질감, 정교한 렌즈 작업을 통해 마치 고예산 영화 오프닝처럼 보이는 장면이 있었습니다. 왼쪽에? 만화 같고 강압적인 느낌이 드는 공격적으로 과포화 된 "피처럼 붉은 하늘". 오른쪽의 승자는 HappyHorse였습니다.

드러내다:

"기자회견" 프롬프트 — 다중 문자 일관성에 대한 고전적인 테스트입니다. HappyHorse(오른쪽)가 성공했습니다. 클로즈업에서 와이드 샷으로의 카메라 전환이 원활하게 진행되어 미디어 스크럼의 혼란스러운 에너지를 완벽하게 포착했습니다. 반면 왼쪽의 경쟁자는 "엉뚱한" 느낌을 받았습니다. 캐릭터 배치가 어색하고 분위기가 부족했습니다.

드러내다:

왼쪽에 있는 클립은 카메라 줌을 급격하게 조정하여 거슬리는 효과를 만들어냈고, 피사체의 얼굴은 **'불쾌한 골짜기'**가 느껴질 정도로 어색했습니다. 반면 HappyHorse(오른쪽)는 피부의 미세한 질감(모공, 주름, 그림자)을 유지하며 영화 같은 줌을 보여주었습니다.

평결: 통계적 변칙?

HappyHorse가 옵션일 때마다 저는 거의 90%의 시간 동안 그것을 선택했습니다. 이것은 단지 "새 모델"의 범프가 아닙니다. 모델이 맹목적인 환경에서 Veo와 같은 기존 거대 기업과 PixVerse와 같은 전문 플레이어를 지속적으로 이기기 위해서는 기본 물리학과 미학적 논리가 근본적으로 우수해야 합니다. 사용자들이 이미 언급한 대로 바로 1위 자리에 "급등"된 것은 놀라운 일이 아닙니다.

워크플로우 혁명 - 왜 HappyHorse가 이기는가

소음을 차단해 보겠습니다. HappyHorse는 단순한 모델이 아닙니다. 이는 AI 영화 제작의 세 가지 가장 큰 문제점을 해결하기 위해 설계된 프로덕션급 엔진입니다.

오디오 동기화, 현지화 및 제어

네이티브 멀티모달: "무성 비디오"의 종말

무음 클립을 생성하고 타사 오디오 도구와 씨름하던 시대는 끝났습니다. HappyHorse는 비디오와 고품질 오디오를 동시에 생성하는 통합 아키텍처를 활용합니다.

글로벌 립싱크: 7개 언어, 끊김 없는

HappyHorse는 기본적으로 7개 언어(영어, 중국어, 일본어, 한국어, 프랑스어, 독일어, 스페인어)를 지원합니다. 입의 움직임을 단순히 "중첩"하는 경쟁사와 달리 이 모델은 입술의 실제 물리학을 각 언어의 음성학에 적용합니다. 현지화된 콘텐츠는 마침내 나쁜 더빙이 아닌 진짜처럼 보입니다.

업계를 파괴하는 요인: 개방형 주권

현재 업계 소문과 유출된 GitHub 리포지토리가 사실이라면 HappyHorse-1.0은 총 투명성에 중점을 두고 잠재적으로 4월 10일 데뷔를 앞두고 있습니다. 경쟁사와 달리 이 소문은 커뮤니티를 위해 구축된 모델을 제안합니다.

오픈 소스 엣지

- 어디서나 실행: 로컬 하드웨어에서 자유롭게 실행할 수 있습니다.

- 제로 "크레딧 부담": 재접수할 때마다 사용량이 측정되거나 값비싼 토큰이 필요하지 않습니다.

- 개인 정보 보호 우선: 서버를 떠나지 않고 자신의 IP로 모델을 미세 조정합니다.

2026년 헤비급 대결: 그들이 쌓이는 방법

| 특징 | HappyHorse 1.0 | Seedance 2.0 | Kling 3.0 (Omni) | Sora 2 (Pro) | Google Veo 3.1 |

|---|---|---|---|---|---|

| 모델 접근 방식 | 가중치 공개(4월 10일) | 비공개 / 웹 & API | 비공개 / 프로 구독 | 폐쇄 / 기업 | 비공개/Vertex AI 베타 |

| 오디오 아키텍처 | 네이티브 멀티모달 | 통합(사후 동기화) | 네이티브 옴니싱크 | 후처리 | 네이티브 통합 |

| 최대 해상도 | 1080p 시네마틱 | 4K | 1080p | 1080p / 2K | 1080p |

| 립싱크 지원 언어 | 7개 언어 | 기본 | 글로벌(옴니모델) | 없음 / 최소 | 기본 |

| 모션 물리학 | 하이/시네마틱 로직 | 익스트림/다이내믹 | 매우 유동적/현실적 | 높음/이론적 | 안정적/일관적 |

빠른 시작 가이드 - 'Happy Horse'에 올라타는 방법

현재 공식 GitHub 저장소에 "Coming Soon" 자리 표시자가 표시되어 있는 가운데 AI 커뮤니티는 4월 10일을 잠재적인 "진실의 순간"으로 보고 있습니다. 최종 코드 푸시를 기다리는 동안 기술적인 마찰 없이 파도를 탈 수 있는 위치를 잡는 방법은 다음과 같습니다.

1로컬 경로: 하드코어 개발자를 위한

GitHub/HuggingFace의 가중치가 떨어지면 상당한 하드웨어 요구 사항에 대비하세요.

요구 사항: 추론을 위한 최소 24GB VRAM(RTX 4090); 프로덕션급 속도를 위한 NVIDIA H100.

설정: Python 3.10 환경과 최신 CUDA 드라이버가 필요합니다.

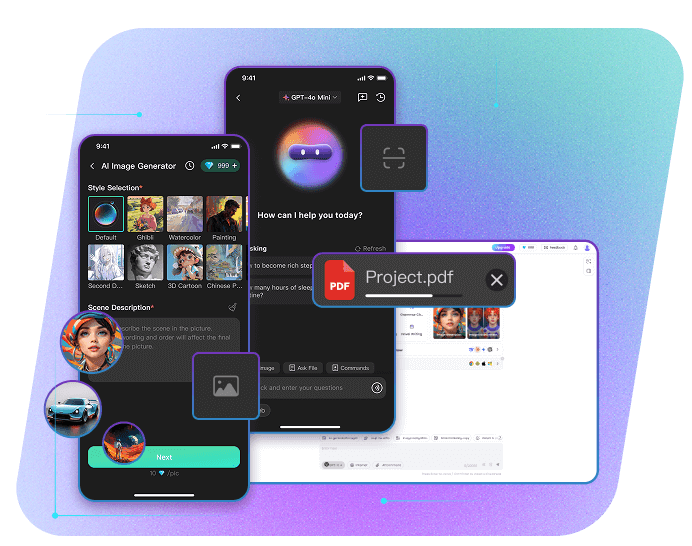

2제작 경로: ChatArt(권장)

고급 GPU 클러스터가 없는 경우 HappyHorse를 사용하는 가장 효율적인 방법은ChatArt

ChatArt는 이미 차세대 비디오 모델을 지원하기 위해 인프라를 최적화했습니다. 로컬 종속성과 씨름하는 대신 클라우드 성능을 활용하여 다음을 수행할 수 있습니다.

ChatArt- 올인원 AI 크리에이티브 어시스턴트.

이미 5,323,556명의 사용자가 경험했습니다!

- 올인원 모델 허브: HappyHorse 1.0, Seedance 2.0, Kling 등 세계 최고의 AI 엔진으로 구성된 강력한 엔진에 액세스하세요.

- 전문가급 비디오 템플릿: 전문가 수준의 시각적 사전 설정이 포함된 방대한 라이브러리를 사용하여 고급 AI MV와 소셜 미디어 광고를 즉시 제작하세요.

- 100명 이상의 크리에이티브 어시스턴트: 대본 작성, 고화질 이미지 구성 등 모든 창의적인 틈새 시장을 위한 전용 AI 비서와 함께 단순한 채팅을 뛰어넘으세요.

- 하드웨어가 필요 없는 렌더링: 값비싼 GPU를 건너뛰세요. 브라우저에서 직접 1080p 영화 비디오와 기본 립싱크를 렌더링하세요.

- 통합 멀티모달 제품군: 텍스트, 이미지, 비디오 사이의 간격을 원활하게 연결합니다. 하나의 유동적인 생태계 내에서 스토리를 생성하고, 캐릭터를 디자인하고, 최종 영화적 걸작을 렌더링하세요.

FAQ: HappyHorse에 대해 알아야 할 모든 것

1HappyHorse란 정확히 무엇인가요?

알리바바 미래생활연구소의 최첨단 AI 영상 모델입니다. 현재 T2V(텍스트-비디오) 및 I2V(이미지-비디오) 벤치마크를 모두 장악하며 인공 분석 비디오 분야에서 1위 자리를 차지하고 있습니다.

2Sora나 Seedance 2.0보다 정말 우수한가요?

인간의 선호도(블라인드 테스트)에서는 그렇습니다. 현재 시각적 충실도와 '영화적 느낌'이 앞서고 있습니다.

3립싱크는 어떤 언어를 지원하나요?

기본적으로 영어, 중국어, 일본어, 한국어, 프랑스어, 독일어, 스페인어 등 7개 언어를 지원합니다. 그것은 단지 "더빙"이 아닙니다. 각 언어의 발음 뉘앙스와 일치하도록 입의 실제 물리학을 조정합니다.

4언제 어디서 다운로드할 수 있나요?

이 모델은 2026년 4월 10일에 오픈 소스 릴리스로 예정되어 있습니다. GitHub에서 가중치를 확인할 수 있습니다.

5고사양 GPU가 없어도 사용할 수 있나요?

전적으로. 기술 설정 및 하드웨어 비용을 건너뛰고 싶다면 HappyHorse 및 기타 최상위 모델(예: Seedance 2.0)에 액세스하는 가장 쉬운 방법은 ChatArt를 이용하는 것입니다.

결론

HappyHorse의 등장은 고급 비디오에 대한 "소라 스타일" 독점의 종식을 의미하며, 네이티브 멀티모달 세대와 오픈 소스 철학의 완벽한 결합을 통해 제작자에게 권력을 다시 돌려줍니다. 완전한 로컬 제어를 원하는 개발자이든 ChatArt의 원활한 클라우드 성능을 활용하는 감독이든 4월 10일 출시는 새로운 현실을 의미합니다. 병목 현상은 더 이상 값비싼 하드웨어나 폐쇄형 알고리즘이 아니라 단지 상상에 불과합니다.

![Seedance 2.0 AI 비디오 생성기 이용 방법 [4가지]](https://images.imyfone.com/chatartweben/assets/articles/blog/seedance-pic.jpg?x-oss-process=image/resize,w_320)

Seedance 2.0 AI 비디오 생성기 이용 방법 [4가지]

Seedance 2.0 프롬프트 작성 완벽 가이드 | 영화 같은 AI 영상 제작하기

Seedance 2.0 리뷰: 멀티모달 AI 영상 편집을 쉽게 만드는 방법 (2026)